TiDB实战解析 揭秘分布式数据库的数据存储原理

在大数据时代,如何高效、可靠地存储海量数据成为众多企业面临的挑战。TiDB作为一款开源的分布式NewSQL数据库,其独特的数据存储架构使其能够同时支持在线事务处理(OLTP)和在线分析处理(OLAP)场景。本文将深入剖析TiDB的数据存储原理,并结合实战应用,揭示其如何实现数据的高可用与水平扩展。

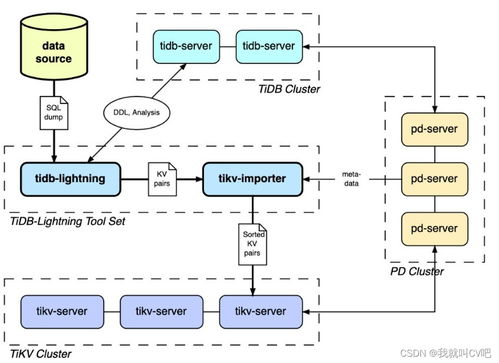

一、 TiDB整体架构与存储定位

TiDB的整体架构分为三层:

- TiDB Server(计算层):无状态的SQL处理层,负责接收客户端连接、解析SQL、制定查询计划,并通过TiKV API与存储层交互。它本身不存储数据,因此可以轻松水平扩展。

- PD(Placement Driver,调度层):整个集群的“大脑”,负责管理元数据、分配全局唯一且递增的时间戳(TSO),以及最关键的任务——调度Region,确保数据负载均衡和高可用。

- TiKV Server(存储层):这是数据存储的核心。TiKV是一个分布式的、支持事务的键值存储引擎,数据持久化存储于此。

本文聚焦的“数据存储”,其核心战场正是在TiKV层。

二、 TiKV存储引擎核心原理

TiKV的存储设计巧妙地融合了多项成熟技术,构建了一个强大而可靠的基石。

1. 数据模型:有序的Key-Value Map

TiKV对外暴露的是一个有序的、支持事务的Key-Value Map。这个“有序”特性至关重要。所有数据(包括表数据、索引)最终都会被编码成Key-Value对(KV对)。

- Key的设计遵循特定格式,例如对于表数据,其结构通常为:

t{table<em>id}</em>r{row_id},这确保了同一张表的数据在键空间中是连续存储的。 - 这种有序排列为高效的范围查询(Range Scan)奠定了基础,也是实现分布式事务和多版本并发控制(MVCC)的关键。

2. 底层存储:RocksDB

TiKV没有重复造轮子,而是选择将数据持久化工作交给了业界久经考验的单机存储引擎——RocksDB(一个基于LSM-Tree的KV存储库)。每个TiKV节点内部都运行着一个RocksDB实例,负责将数据高效地写入磁盘。RocksDB出色的写性能和顺序读性能,为TiKV提供了坚实的单机存储能力。

3. 数据分片与调度:Region

这是TiDB实现水平扩展的核心。TiKV不会将整个巨大的KV Map存储在一个节点上,而是将其动态切分为一系列连续的片段,每个片段称为一个Region。

- 每个Region默认大小约为96MB~144MB,负责存储一个连续键范围([startkey, endkey))内的所有数据。

- Region是数据移动、复制和负载均衡的最小单位。PD会持续监控所有TiKV节点上Region的数量和大小,一旦发现某个节点负载过高(Region过多),就会自动将部分Region调度到负载较低的节点上,整个过程对应用透明。

4. 高可用保障:Raft共识算法

单机存储必然存在单点故障风险。TiKV通过Raft协议解决了这一问题。

- 每个Region的数据都会在多个TiKV节点(通常为3个副本)之间复制,形成一个Raft Group。

- 该Group中有一个Leader副本负责处理该Region的所有读写请求,其他Follower副本同步数据。

- 当Leader所在节点发生故障时,剩余的Follower副本会通过Raft协议快速选举出新的Leader,继续提供服务,实现了自动故障转移(Failover),通常能在秒级内恢复,保证了高可用性(HA)。

5. 事务与MVCC:分布式事务的核心

TiDB支持完整的分布式ACID事务,其实现依赖于在KV模型上构建的多版本并发控制(MVCC)。

- 每次对数据的修改(增删改)都不会直接覆盖原数据,而是会生成一个带时间戳(从PD获取的TSO)的新版本。

- 每个KV对都可能关联着多个按时间戳排序的版本。读操作根据事务开始的时间戳,读取对应时间点之前的最新数据版本,从而实现无锁的快照读(Snapshot Read),避免了读写冲突。

- 对于写操作,TiDB采用了优化的两阶段提交(2PC)协议,结合MVCC来保证跨多个Region(即跨多个TiKV节点)的事务的原子性和隔离性。

三、 实战视角:数据存储操作流程示例

让我们通过一个简单的SQL写入操作,串联起上述原理:

场景:向用户表users(假设table_id=1)插入一行数据 (id=100, name='张三')。

- SQL解析与计划:客户端连接TiDB Server,发送INSERT语句。TiDB Server解析SQL,确定需要写入的表和行。

- Key编码与路由:TiDB Server根据数据模型,将这一行数据编码为KV对。Key可能类似

t1_r100,Value包含name等信息。TiDB Server知道需要将此KV对写入哪个键范围,进而通过查询PD或缓存,定位到负责该键范围的Region Leader所在的具体TiKV节点地址。 - Raft提案与复制:TiDB Server将写请求发送给目标Region的Leader TiKV节点。该节点的Raft层将此写操作作为一个提案(Proposal)提交给本地的Raft状态机,并同时通过Raft协议复制给该Region Group内的其他Follower节点。

- 多数派提交与持久化:当提案被集群中的多数派(如3副本中的2个)确认并持久化到各自的RocksDB中后,Raft协议认为该日志已提交(Committed)。

- 应用状态机与返回:Leader TiKV将已提交的日志条目应用到本地的KV状态机,即实际写入(或更新)其RocksDB实例。写入成功后,Leader将成功响应返回给TiDB Server。

- 客户端确认:TiDB Server收到TiKV的成功响应后,向客户端返回执行成功。

整个过程中,PD持续在后台监控所有Region的状态,如有节点宕机或数据分布不均,会触发平滑的Region调度。

四、 存储相关实战优化要点

- 热点Region处理:如果某一行或某一个小范围的数据被极高频率访问(如电商秒杀商品),可能导致单个Region成为热点。解决方案包括:使用TiDB的

SHARD<em>ROW</em>ID_BITS等特性打散行ID,或者从业务设计上避免极端热点。PD也会通过拆分(Split)过热的Region来分散压力。 - 存储容量规划:TiKV的存储容量取决于节点数量、副本数(通常3)和单机磁盘大小。规划时需预留空间,因为Region分裂、RocksDB压缩等操作需要额外空间。

- 监控关键指标:在运维中,需密切关注 TiKV集群存储容量、Region分布均衡度、Raft IO延迟、Leader/Follower数量以及RocksDB的读写放大等指标,这些是集群健康度的关键信号。

###

TiDB通过将数据抽象为有序KV模型,并基于RocksDB、Region分片、Raft复制协议和MVCC这四大支柱,构建了一个既弹性扩展又稳定可靠的分布式存储层。理解TiKV的存储原理,不仅有助于更好地使用TiDB,也能为设计分布式系统提供宝贵思路。在实际应用中,结合具体的业务负载模式进行合理的集群部署、参数调优和监控,是发挥TiDB存储威力的关键。

如若转载,请注明出处:http://www.wzswzz.com/product/23.html

更新时间:2026-05-20 07:55:39